Prompt Security

Founded Year

2023Stage

Acquired | AcquiredTotal Raised

$23MValuation

$0000Revenue

$0000About Prompt Security

Prompt Security operates within the cybersecurity industry, focusing on artificial intelligence (AI) security solutions. The company provides a platform that addresses risks associated with generative AI, including preventing prompt injections, blocking data leaks, and filtering harmful content generated by language models. Prompt Security serves sectors such as healthcare and finance, providing tools and services to facilitate the adoption of AI technologies. It was founded in 2023 and is based in New York, New York. In August 2025, Prompt Security was acquired by SentinelOne at a valuation between $250M and $300M.

Loading...

ESPs containing Prompt Security

The ESP matrix leverages data and analyst insight to identify and rank leading companies in a given technology landscape.

The AI security market provides specialized solutions designed to protect machine learning models, algorithms, and AI applications from AI-specific threats including adversarial attacks, data poisoning, model evasion, backdoor injections, prompt injection, and model theft. These vendors offer products spanning the entire AI lifecycle, including secure model development frameworks, runtime protecti…

Prompt Security named as Leader among 15 other companies, including Chainguard, Snyk, and Skyflow.

Prompt Security's Products & Differentiators

AI Security Platform

Prompt Security gives enterprises a unified platform to safeguard every part of their AI journey. From employees use of public AI tools, copilots and AI agents, to protecting homegrown AI applications from threats like prompt injection, data leakage, and content toxicity, delivering instant visibility, granular policy control, and runtime security at scale. Four key modules: - Prompt for Employees - Prompt for AI Code Assistants - Prompt for Agentic AI - Prompt for Homegrown Applications

Loading...

Research containing Prompt Security

Get data-driven expert analysis from the CB Insights Intelligence Unit.

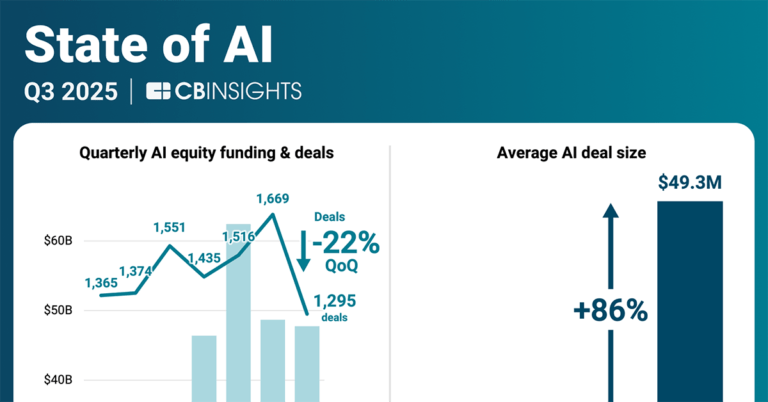

CB Insights Intelligence Analysts have mentioned Prompt Security in 1 CB Insights research brief, most recently on Oct 30, 2025.

Oct 30, 2025 report

State of AI Q3’25 ReportExpert Collections containing Prompt Security

Expert Collections are analyst-curated lists that highlight the companies you need to know in the most important technology spaces.

Prompt Security is included in 3 Expert Collections, including Generative AI.

Generative AI

2,951 items

Companies working on generative AI applications and infrastructure.

Artificial Intelligence (AI)

37,222 items

Companies developing artificial intelligence solutions, including cross-industry applications, industry-specific products, and AI infrastructure solutions.

Cybersecurity

11,028 items

These companies protect organizations from digital threats.

Latest Prompt Security News

Sep 26, 2025

El verano pasado se informó de que a OpenAI, la empresa responsable de ChatGPT, le habían robado información sobre el diseño del chatbot. Según el New York Times , el agresor obtuvo detalles sobre cómo la empresa construye sus herramientas de IA fisgoneando en un foro utilizado por los empleados de OpenAI. Pero aunque no se cree que los sistemas utilizados para construir y ejecutar la IA fueran pirateados, el incidente demostró cómo los sistemas de IA -y los centros de datos utilizados para albergarlos y entrenarlos- son objetivos principales para los ciberatacantes. La razón es sencilla: a medida que la IA se integra más en nuestras vidas, más valiosos son los algoritmos que la sustentan y los conjuntos de datos con los que se entrenan. Y no sólo las enormes cantidades de información que procesan los proveedores de IA y sus plataformas son extremadamente valiosas para los ciberdelincuentes y los actores de amenazas maliciosas, sino que también existe el riesgo de que los atacantes intenten hacerse con los secretos y el código fuente que impulsan la IA. Atacar la IA Porque, como ocurre con cualquier tipo de nueva tecnología, software o producto, hay quien quiere hacerse con él por todos los medios. Eso puede incluir piratear el centro de datos donde se aloja, ya sea para hacerse con la propiedad intelectual necesaria para construir su propia versión, robar información o llevar a cabo una serie de otros actos maliciosos. "El valor de los datos alojados en estos centros de datos es cada vez mayor, por lo que se están convirtiendo en un objetivo cada vez más importante, y cada vez más partes del mundo se ejecutan en infraestructuras que se encuentran en estos entornos", afirma Paul Shaver, responsable de seguridad de tecnología operativa global de Google Cloud Security. "Se han convertido en infraestructuras críticas con bastante rapidez en la forma en que nos inclinamos a aprovechar cada vez más la nube y la tecnología de IA" Al igual que con otras formas de infraestructura crítica, los centros de datos que albergan herramientas de IA se convierten rápidamente en un objetivo muy tentador para los ciberatacantes. Y mientras que las formas más tradicionales de infraestructuras críticas, como la energía, el procesamiento de alimentos y los sistemas de suministro de agua pueden funcionar en sistemas protegidos por aire, la propia naturaleza de la IA significa que los centros de datos que la alimentan están directamente frente a Internet. Aunque necesario, esto significa que esta forma de infraestructura crítica es potencialmente más vulnerable a intrusiones no autorizadas “Los atacantes están aprovechando la IA para identificar formas de explotar estos sistemas”. Paul Shaver "Aumenta la superficie de ataque", afirma Shaver. "Estás poniendo más en Internet con más conectividad en estos entornos, lo que presenta otro vector de ataque que necesita ser monitoreado, controlado y actualizado" Naturalmente, los ciberdelincuentes son conscientes de esta superficie de ataque ampliada en torno a los centros de datos que alojan IA y están tratando de aprovecharla. Y con muchos sistemas de IA alojados en infraestructuras basadas en la nube, los hackers intentarán explotar las mismas técnicas que utilizan para atacar aplicaciones basadas en la nube: como el uso de ataques de suplantación de identidad o phishing para hacerse con credenciales legítimas, o quizás incluso la distribución de malware para proporcionarles una puerta trasera secreta al sistema. Y cada vez utilizan más herramientas de IA para ayudar a llevar a cabo los ataques. "Los atacantes están aprovechando la IA para identificar formas de explotar estos sistemas, para escribir correos electrónicos de phishing y para escribir código malicioso", dice Shaver. Pero también hay otro vector de amenaza en el que pensar a la hora de proteger los centros de datos que almacenan los modelos: la cadena de suministro. "Porque por su propia naturaleza, los LLM y la IA dependen en gran medida de integraciones y API, lo que significa que hay muchas conexiones y marcos de terceros", dice Michael Adjei, director de ingeniería de sistemas de Illumio. "El problema es que la mayoría son nuevos. Si tienes algo que es nuevo, que no ha sido sometido a pruebas de estrés, es un blanco fácil para las bandas cibernéticas. Sobre todo si se ha invertido mucho en I+D para llegar al punto en el que la propiedad intelectual es comercial", explica. Muévete rápido y rompe cosas (y olvídate de protegerlas) Es una historia tan antigua como la tecnología: cuando algo es nuevo y emocionante, las empresas están deseando lanzar su nuevo producto lo antes posible, especialmente si compiten con sus rivales por una cuota de mercado. Pero la velocidad a la que se lanzan los productos al mercado puede acarrear problemas, sobre todo en lo que respecta a la seguridad de los sistemas. Desgraciadamente, es poco probable que una organización que quiera asegurarse de ser la más rápida en salir al mercado pruebe todos los aspectos de su producto, por no hablar de examinar las herramientas y empresas utilizadas en su cadena de suministro. Y eso crea oportunidades para los atacantes oportunistas. "Si soy un Estado-nación y veo que a tu empresa le va bien, dedicaré recursos a intentar robar esa información, en lugar de construirla desde cero", afirma Adjei. "Si saben que funciona, pueden robarla y hacerla suya" La rapidez con la que la IA y los LLM se hicieron públicos y se convirtieron en herramientas de uso generalizado por parte de las empresas provocó una escasez de GPU, ya que los proveedores de IA se apoderaron de ellas para permitir el procesamiento de alta potencia necesario para ejecutar y entrenar sus modelos. – Getty Images Todavía hay solo un puñado de grandes empresas -encabezadas por Nvidia y AMD- que fabrican y suministran GPU adecuadas para los centros de datos de IA. Un atacante astuto y con recursos podría aprovecharse de ello corrompiendo la cadena de suministro de forma que le proporcionara acceso directo a los centros de datos. "Si tuviera que priorizar las mayores preocupaciones, diría que la mayoría de las grandes empresas utilizan determinados proveedores de LLM y todos ellos utilizan determinado hardware: las GPU más elegantes, nuevas y brillantes. Si puedes conocer esos proveedores de IA y el hardware, entonces quizá un atacante podría plantar algo en la cadena de suministro", sugiere Itamar Golan, CEO y cofundador de Prompt Security. "Podrías envenenar potencialmente el hardware utilizado para entrenar a los LLM. Si puedes entrar en la cadena de suministro de las GPU, puedes hacerlas vulnerables a ciertas entradas y palabras clave, y ahora puedes tomar el control desde el nivel de hardware. Es algo a tener en cuenta" Envenenamiento del suministro de datos El envenenamiento de datos se produce cuando un actor malicioso inserta intencionadamente datos falsos en los datos de entrenamiento de una IA con el objetivo de manipular o cambiar el funcionamiento del modelo. La mayoría de las veces, de una forma diseñada para perturbar el funcionamiento de la IA o engañarla para que divulgue datos sensibles o perjudiciales. "Pueden hacerlo de muchas maneras. Pueden piratear tu sistema y añadir muestras falsas. Pueden utilizar lo que tú añades, como los comentarios de los clientes, pero sesgarlo intencionadamente hacia un comportamiento que no sea la media. Pero al final, tu modelo se está entrenando con datos sesgados o malintencionados", explica Golan. "Las consecuencias pueden ir desde simplemente no generar buenos resultados porque el conjunto de entrenamiento está impactado, hasta ser capaz de generar contenido dañino. Podría ser vulnerable a un token secreto que se puede utilizar para tomar el control del modelo y otras capacidades maliciosas sofisticadas." "No estamos reinventando la rueda, la rueda simplemente se mueve más rápido". Paul Shaver Por tanto, es esencial proteger los centros de datos que se utilizan para entrenar los modelos de IA, sobre todo a medida que su uso se generaliza en las empresas y la sociedad. "La IA se ha convertido en algo omnipresente y no podemos evitarla, por lo que los proveedores tienen una mayor responsabilidad a la hora de garantizar su protección", afirma Adjei. "Ya sea que se trate de estados-nación que quieren robar su modelo, o un actor de amenaza que quiere usar inyecciones rápidas para manipular su modelo, ese riesgo es real" Entonces, ¿qué medidas deben tomar los operadores de centros de datos de IA para garantizar que su infraestructura permanezca protegida contra ciberataques, envenenamiento de datos y otras amenazas? En muchos sentidos, los operadores deberían seguir las mismas estrategias de ciberseguridad que los que aseguran cualquier otro sistema o infraestructura. "Pensamos en la IA como esta cosa nueva -y en gran medida lo es- pero la tecnología en su conjunto tiene el mismo ciclo de vida de buena higiene de seguridad, buenas detecciones, probando esas capacidades contra escenarios de ataque del mundo real basados en el panorama de amenazas", dice Shaver. "No estamos reinventando la rueda, sólo que la rueda va más deprisa. Así pues, se trata de prestar atención al panorama de las amenazas, desarrollar la higiene de la seguridad y las defensas frente a lo que hacen los atacantes. Los ataques cambian, los exploits cambian, pero el ciclo de vida de la protección de la IA no es diferente", concluye. Más sobre Security and Risk Patrocinado Protección inteligente y sostenible: sistemas de agua nebulizada en los data centers 23 Jun 2025 Una década de riesgos: señales de seguridad en una era de tensión geopolítica 09 Jul 2025 Un incendio en un centro de datos de Telecom Egypt deja cuatro muertos y 26 heridos A version of this story appeared on Securing the AI data center on septiembre 25, 2025

Prompt Security Frequently Asked Questions (FAQ)

When was Prompt Security founded?

Prompt Security was founded in 2023.

Where is Prompt Security's headquarters?

Prompt Security's headquarters is located at 500 7th Avenue, New York.

What is Prompt Security's latest funding round?

Prompt Security's latest funding round is Acquired.

How much did Prompt Security raise?

Prompt Security raised a total of $23M.

Who are the investors of Prompt Security?

Investors of Prompt Security include SentinelOne, Hetz Ventures, Ridge Ventures, F5, Okta Ventures and 8 more.

Who are Prompt Security's competitors?

Competitors of Prompt Security include Bedrock Data, Hardshell, Aim Security, Protect AI, U-Rec and 7 more.

What products does Prompt Security offer?

Prompt Security's products include AI Security Platform.

Loading...

Compare Prompt Security to Competitors

Harmonic Security focuses on secure artificial intelligence (AI) adoption within enterprises, specializing in data protection and security for the AI era. The company offers solutions that protect sensitive data, increase visibility into unauthorized AI applications, and ensure compliance while supporting innovation. Harmonic Security serves sectors integrating generative AI tools and maintaining data security measures. It was founded in 2023 and is based in San Francisco, California.

Quilr focuses on human risk management and cybersecurity within the technology sector. The company provides solutions that aim to guide user behavior, detect threats in real-time, and automate security responses while maintaining reduced services. Its services include facilitating artificial intelligence adoption, enabling data sharing, protecting software as a service identities, and addressing security alerts. The company was founded in 2023 and is based in Austin, Texas.

HiddenLayer specializes in providing security for artificial intelligence, operating within the cybersecurity and AI industries. The company offers a security platform that helps enterprises protect their machine learning models from adversarial attacks without adding complexity or requiring access to sensitive data. HiddenLayer's solutions are designed to safeguard proprietary AI models, prevent data exposure, and ensure the integrity of model performance. It was founded in 2022 and is based in Leander, Texas.

Bedrock Data focuses on data security, governance, and management within the data management and cybersecurity sectors. The company provides a platform for data security and governance processes, offering solutions for data discovery, classification, and lifecycle management. It serves various sectors including biotech, finance, healthcare, media & entertainment, retail, and technology, by providing a view and control over data assets. Bedrock Data was formerly known as Bedrock Security. It was founded in 2021 and is based in Menlo Park, California.

DomainTools specializes in internet intelligence and cybersecurity, providing solutions to identify external risks, investigate threats, and proactively protect organizations. The company offers a suite of products that include domain and DNS data analysis, threat intelligence feeds, and risk scoring, as well as integration capabilities with various security tools. Its services cater to a diverse range of industries, including federal government, financial services, healthcare, technology, and retail, aiming to enhance cybersecurity resilience and threat response. It was founded in 2004 and is based in Seattle, Washington.

BforeAI provides predictive threat intelligence and Digital Risk Protection Services in the cybersecurity industry. The company offers solutions that use behavioral AI to address cyber threats, including threat intelligence, brand protection, adversary disruption, and infrastructure takedowns. BforeAI's services aim to mitigate online fraud and malicious campaigns. It was founded in 2020 and is based in Nouvelle-Aquitaine, France.

Loading...